私達の日常生活では、デジタルとの融合が欠かせなくなってきました。AI技術は急速に発展を続けていて、人手不足や安全確認等の課題解決に繋がる点でも注目されています。

特に視覚障がいのある方の生活において、減少傾向にある盲導犬や同行補助者の役割をAI技術が担えるとの考えが増えてきました。その研究開発をしているのは、2015年に創業した株式会社コンピュータサイエンス研究所です。

Mobility for ALLでは、開発中のアプリ「Eye Navi(アイナビ)」を用いて視覚障がいのある方の安心安全な歩行を可能にすることに挑戦します。「誰もがサーキット等でのスポーツ観戦を楽しめる世の中にしたい」、そんな思いで実証実験に向けて準備を重ねています。

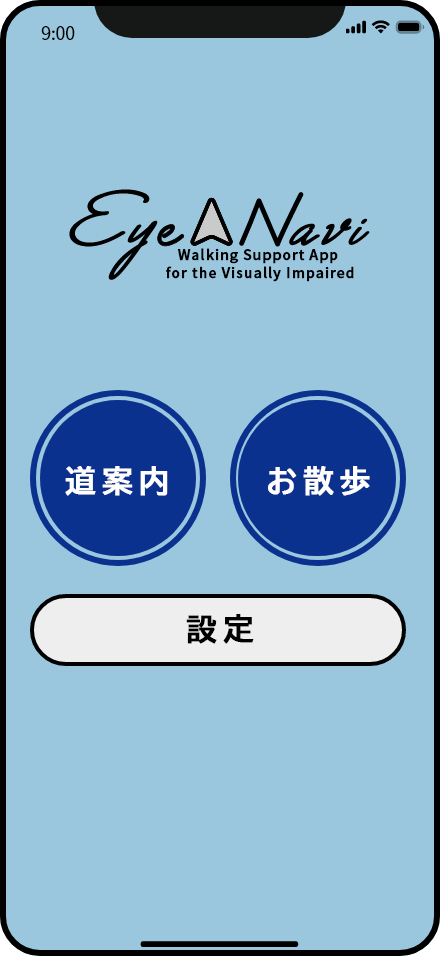

道案内ほか、機能を自由にカスタマイズできる「Eye Navi」

Eye Naviとは、視覚障がい者歩行支援アプリです。AI人工知能を使った画像認識と、視覚障がい者に寄り添った経路案内の2点を実現しています。iPhone専用のアプリとして、2022年度中のリリースを目指し開発中です。

Eye Naviを使う際、まずはアプリを起動し、道案内モードかお散歩モードかを選びます。

次に必要に合わせて、ナビゲーションの内容をカスタマイズします。通常は、自分の正面かつ3~5m先にある障害物を検知しながらナビゲーションしていますが、カスタマイズ次第では広範囲の障害物情報を得ることが可能です。

また自宅や目的地の登録および編集、「カフェ」「銀行」等ナビゲーションする施設のジャンルを選択する機能等があります。Eye Naviを使う方一人ひとりが、使いやすいように設定できるのが最大の特徴です。

iPhoneを首から下げ、カメラで自分の正面を認識できるようにしたらナビゲーションをスタート。道案内モードの場合は、目的地までの経路をあらかじめ案内してくれます。歩き出す前に頭の中で地図をイメージできることで、視覚障がいのある方が少しでも安心して歩き出せるような工夫です。

Eye Naviが障害物として画像認識できるのは、約50種類(2022年9月時点)。例えば点字ブロックや縁石、人、車、歩行者信号等を認識できます。

音声案内の聞き方も、使う人によって変更が可能です。iPhoneから直接音声を聞いたり、Bluetoothでイヤホンを連携させて聞いたり、骨伝導のイヤホンを付けたりできます。

「『視覚障がい』と一言でいっても、見え方や感じ方は一人ひとり違います。Eye Naviが設定を細かくカスタマイズできるようにしたのは、弱視の方も全盲の方も使用できるアプリにしたかったからです」

そう話すのは、株式会社コンピュータサイエンス研究所 代表取締役の林秀美(はやし ひでみ)さんと、プロジェクト担当の髙田将平(たかた しょうへい)さん。Eye Navi開発時のエピソードやMobility for ALLへの意気込みをインタビューしました。

誰もが会場でスポーツ観戦できる世の中に

Mobility for ALLでは、「Eye Navi」の使用により視覚障がいのある方への歩行支援を音声で行うことを提案しています。具体的には、サーキット会場の客席までの道案内と、会場内の案内を実現予定です。

サーキット会場の客席までの道案内では、シャトルバス下車位置からサーキット会場の客席までの案内をEye Naviの音声案内で実施します。

会場内ではお手洗いや出店、最終コーナーを目的地とした、既存の地図上には経路がない場所への案内を検証予定です。会場内外において、人や障害物にぶつからないよう注意喚起を行うほか、曲がるポイントや残りの距離等を音声で伝えていきます。

さらにEye Naviのビデオ通話機能を活用し、オペレーターと繋いで遠隔で歩行をサポートする機能を新たに開発中です。いざというときの安心感を提供できると考えています。

Mobility for ALLへの挑戦を通して、Eye Naviが視覚障がいのある方にとっての安心に繋がる歩行サービスへと進化しながら、サーキット等のスポーツ観戦を誰もが会場で楽しめる社会を目指していきます。

新たな機能を開発し、一人も取り残さない社会を実現したい

道案内と障害物の案内、どちらもEye Naviが叶える

GPSの誤差や点字ブロックがない場所を、どう補うか

周辺の施設案内は、新たに行きたい場所が見つかる可能性を秘めていた

下見を経て、会場内の案内や遠隔のナビゲーションができるよう調整中